هل مازال العقل البشري قادرًا على هزيمة الذكاء الاصطناعي في الحرب؟

[ad_1]

الحرب، ذلك الناقوس الذي يُؤرِّق أكثر من أربعمائة مليون شخص على مُستوى العالم -وِفقًا لبرنامج أوبسالا لبيانات الصراع (UCDP) في دراسة أُجريت عام 2021- مُوزعون على 26 صراعًا حيًا.

الحربُ هي سلاحٌ ذو حدين، لعلها تكون مُفاجأة بالنسبة إليك، ولكنها الحقيقة -فقط نتفق على عدم مُساواة الحدين ببعضهما البعض- الحد الأول هو الفساد التي تُعيثه الحرب في الأرض، الموت والفُقدان، كُل ما تُقدِّمه الحرب من هدايا غير مرغوبة لمن أُجبروا على المُشاركة بها. أما الحد الثاني، فهو أمرٌ قد طال عمره، وهو أنها دائمًا ما تكون الغاية وراء التطوُّر.

بدايةً من عجلاتِ أحمُس الحربية، وحتى اختراع الإنترنت، والذي كان عبارة عن مُجرد مشروع عسكري أمريكي مُوِّل من قِبل وزارة الدفاع الأمريكية حاملًا اسم ARPANET، حيث كان الغرض منه حينها هو تطوير بروتوكلات وتقنيات قادرة على السماح لأجهزة الحاسوب مُتعددة المهام -كما أُطلِق عليها حينها- على مُشاركة البيانات والاتصال ببعضها البعض بسرعاتٍ لم يسبق لها مثيل.

استمرت الحرب في إبهارنا بما تستطيع تقديمه، ولكنها في النهاية يأتي على حساب الكثير من الضحايا من الجانب العسكري والمدني على حدٍ سواء.

سابقًا، تحدثت الزميلة فاطمة القاضي في مقالة عن ماذا لو كانت تقنيات الوقت الحالي موجودة في وقتٍ سابق، ووصلت بخيالها إلى عدم وجود ما يُعرف بالحرب العالمية الثانية من الأساس إذا امتلكت الولايات المُتحدة التقنيات اللازمة لرصد واكتشاف القوات البحرية اليابانية التي كانت على بُعد 5600 كيلو مِترًا فقط من ميناء هاربور الأمريكي في المُحيط الهادئ، لما كان هُناك حربًا.

الأمر ذاته عندما ذهبت بخيالها لما هو أبعد من ذلك، بأن يُشارك أحد الأطفال ممن هم بعمر 14 عامًا مقطع فيديو على تيك توك أثناء انضمامه للجيش الألماني في أربعينيات القرن الماضي، والذي وصل قوامه إلى 5 ملايين جُندي، لما تمكنت بافاريا من غزو الاتحاد السوفيتي.

كُلِ هذا كان من قِبلِ الحربِ أو ما بعدها، أما الآن، فقد وصلنا بالفعلِ إلى عصرٍ مُتقدمٍ للغاية، عصر لم نعد فيه في حاجة للحرب لتُقدِّم لنا التقنيات الحديثة، ولم تعُد الحرب كذلك في حاجة لما هو أكثر مما هو موجود الآن بالفعل، لنرى في النهاية أبشع المشاهد وأكثرها دموية على الإطلاق.

سلامًا على كُلِ روحٍ أُزهِقت في سبيل الدفاع عن المسجد الأقصى.

التقنية في الحرب

أهلًا بك في عام 2023، العام الذي أُطلِق عليه شخصيًا وبجدارة “عام الذكاء الاصطناعي”، فهو في كُلِ مكان، يهدِم، ويبني، يُشتت ويُساعد، يفعل كُل شيء، حتى أنه وصل إلى الحرب، ما قبلها، وما هو خِلالها.

على عكس الحروب كافة التي مضت، بوصولنا إلى هذا العام، فقد اقتربنا كثيرًا من قمة الهرم التقني، ولعلي أقول هذا لقِصر نظري، إلا أننا الآن بالفعل قد أصبحنا مُتقدمين للغاية -على الأقل مُقارنةً بالماضي، وكما هو الحال مع اختراع الديناميت في عام 1867 بواسطة آلفريد نوبل، عندما تسبب اختراعه السلمي في لقاء الكثيرين حتفهم..

أصبح الذكاء الاصطناعي هو ديناميت هذا العصر.

مِثله مثل أي شيء آخر، هو أيضًا سلاح ذو حدين، قد تراه حينًا بزي الملاك، وحينًا آخر، بوجه شيطاني بحت، لا ينفك أن يرفع عينيه من على جبهتك، التي يُركِّز فيها طويلًا طويلًا، حتى يُطلِق رصاصةً آلية مُبرمجة إلى مُنتصف رأسك، لتُودِّع الحياه، على يدِ شيءٍ ليس ببشري، ولا هو حيوان، فقط، نموذج ذكاء اصطناعي، لا يعي ما يفعله.

حروب الذكاء الاصطناعي

إن الذكاء الاصطناعي ليس مستقبل روسيا فحسب، بل مستقبل البشرية جمعاء – فلاديمير بوتين، سبتمبر 2017.

كمُقدمة أعلم أنك قد لا تحتاجها عن الذكاء الاصطناعي، هو ببساطة قيام الآلة بتنفيذ المهام التي تتطلب ذكاءً بشريًا، كالإدراك البصري والتعرُّف على الكلام، اتخاذ القرارات وترجمة وفهم اللغات.

اتباعًا لهذا المفهوم، تُطوِّر الدول بشكلٍ عام والجيوش العسكرية بشكلٍ خاص تقنيات الذكاء الاصطناعي بما يتناسب مع احتياجاتها، فهذا يستخدمها في الدفاع عن نفسه، وذاك يستخدمها في التدرُّبِ على الهجوم، ولكن الأكيد، أن حربُ ما قبل الذكاء الاصطناعي، ليست كالتي بعده.

في الوقت الحالي، يلعب الذكاء الاصطناعي دورًا حيويًا للغاية في الحروب، وتُحاول دولٌ مثل الولايات المُتحدة والصين وروسيا الاستفادة منه بأقصى درجة مُمكنة، ولكن; هذه المُحاولات ذات مخاطرٍ عديدة، قد تُواجه صانعي أدواء الحرب الذكية أنفسهم، فكان من اللازم وضع بعض القواعد والقوانين والأسُس الأخلاقية للحد من مخاطر الذكاء الاصطناعي في الحروب.

ولكن; قبل هذا، دعني آخذك في رحلة عسكرية، لأُعرفِّك على كيفية استخدام ما تستخدمه أنت في الإجابة على أسئلة الامتحانات، في حروب الجيل الخامس.

الاستقلالية والأتمتة

بدايةً، دعني أُعرِّفُك على مُصطلحين يتم الخلط بينهما لقربهما من بعض من الناحية اللغوية، فهُما (Autonomy and Automation)، وبسبب التشابه بين كُلٍ منهما في الوظائف، فقط مع اختلافٍ واحد، وهو القواعد.

عندما يرغب الناس في إنجاز مهمة، يقومون بها بأنفسهم أو يفوضونها إلى كيان آخر، والذي يمكن أن يكون إنسانًا أو آلة. عند التفويض، يتخلى المُفوِّض عن بعض السيطرة على كيفية القيام بالمهمة، ويكون للكيان الذي يقوم بالمهمة درجة من الاستقلالية. إذا كانت المهمة مكتوبة بشكل مثالي مع مجموعة من القواعد المحددة والمعروفة، فإن التقنيين يقولون إن الكيان الذي يقوم بها لديه “استقلالية منخفضة – Low Autonomy” ويصفونه بأنها “مؤتمتة – Automated”. إذا كان الكيان الذي يقوم بالمهمة مخولًا بالمتابعة دون قواعد أو حدود، فإنه يُوصف بأنه “مستقل – Autonomous” تمامًا. تقع جميع المهام تقريبًا التي تؤديها الآلات في مكان ما بين هذين النقيضين، لذلك من المنطقي مناقشة تطبيقات الذكاء الاصطناعي من حيث درجات أو مستويات الاستقلالية.

يُميِّز الخبراء في مجال الذكاء الاصطناعي غالبًا بين نوعين من الاستقلالية: الاستقلالية الساكنة (autonomy-at-rest) والاستقلالية المتحركة (autonomy-in-motion).

تصف الاستقلالية الساكنة الأنظمة التي تعمل في البرمجيات أو في العالم الافتراضي، مثل برامج المُحادثة وفلاتر البريد الإلكتروني العشوائي أو غير المرغوب فيه.

أما الاستقلالية المتحركة فهي تصف الأنظمة التي تتفاعل بشكل كبير مع العالم المادي، مثل السيارات ذاتية القيادة والأذرع الآلية.

هذا التمييز مهم لأنه يؤثر على كيفية تصميم واختبار هذه الأنظمة. يمكن اختبار وتقييم الأنظمة ذات الاستقلالية الساكنة غالبًا في بيئة محاكاة، بينما يجب اختبار وتقييم الأنظمة ذات الاستقلالية المتحركة في العالم الحقيقي. قد يكون هذا أكثر صعوبة وتكلفة، لكنه ضروري لضمان سلامتها و موثوقيتها.

برغم أن القلق يتركز على الأنظمة ذاتية الحركة، والتي لها تأثير على الواقع المادي أو الملموس، إلا أنه حتى الاستقلالية الساكنة المُتمثلة في التأثير على العالم الافتراضي فقط، تُصبح أكثر خطورة إذا ما دخلت المجال العسكري.

ذلك لأنها في هذه الحالة، ستُصبح وسيلة لاتخاذ قرارات تنقلنا لاستخدام الأنظمة ذاتية الحركة والتي من ضمنها -مما أثار قلق الباحثين- الأسلحة ذاتية القتل (LAWS). والتي بمجرد إطلاقها، يمكنها أن تبقى في منطقة عمليات محددة لفترة من الوقت، بحثًا عن الأهداف. عندما تحدد هدفًا، تهاجمه وتدمره دون تدخل أي إنسان في المشاركة.

الذكاء الاصطناعي يُقرِّر

يمكن لخوارزميات الذكاء الاصطناعي جمع البيانات ومعالجتها من العديد من المصادر المختلفة للمساعدة في اتخاذ القرارات الهامة، خاصة في المواقف العصيبة.

كما يمكن للذكاء الاصطناعي أيضًا تحييد الأحكام المسبقة التي قد تكون موجودة في المدخلات البشرية، ولكن من المهم ملاحظة أن الذكاء الاصطناعي قد لا يكون لديه فهم متطور تمامًا للمخاوف الأخلاقية البشرية وهناك خطر من أن يتعلم الذكاء الاصطناعي من الأحكام المسبقة التي قد توجد في البيانات التي يتم تدريبه عليها. ومع ذلك، فإن صنع القرار تحت الضغط هو جزء أساسي من كونك فردًا في الخدمة العسكرية، ويمكن للذكاء الاصطناعي والإنسان العمل معًا لتسهيل هذه العملية. من خلال الجمع بين الفهم الأخلاقي للبشر والقدرات التحليلية السريعة للذكاء الاصطناعي، يمكن تسريع عملية صنع القرار.

يتم استخدام الأنظمة المدعومة بالذكاء الاصطناعي لتحليل البيانات من مستشعرات ساحة المعركة لتحديد التهديدات المحتملة. على سبيل المثال، يستخدم الجيش الأمريكي نظام الذكاء الاصطناعي Prophet لتحليل البيانات من الطائرات بدون طيار وغيرها من المستشعرات لتحديد أهداف العدو والتنبؤ بحركاتها.

كما تستخدم القوات الجوية الأمريكية نظام Skyborg لتطوير استراتيجيات للرد على التهديدات الجوية.

أما من الناحية الأخلاقية، فإن هُناك من أنظمة الذكاء الاصطناعي ما يُستخدم لتقليل التحيز في صنع القرار. كنظام EthicalOS الذي تستخدمه وتطوره البحرية الأمريكية (US Navy) لمساعدة القادة على اتخاذ قرارات تتماشى مع المبادئ الأخلاقية.

على الرغم من أن أنظمة الذكاء الاصطناعي يمكن أن تكون مفيدة للغاية في صنع القرار، من المهم أن نلاحظ أنها ليست مثالية وقد ترتكب أخطاء في بعض الأحيان. لذلك، من المهم أن يكون البشر متورطين في عملية صنع القرار لضمان استخدام أنظمة الذكاء الاصطناعي بشكل مسؤول وأخلاقي.

أنظمة الأسلحة والمركبات المستقلة

يتم استخدام الذكاء الاصطناعي لتطوير أنظمة الأسلحة والمركبات ذاتية القيادة، مثل المركبات الجوية بدون طيار (UAVs) والمركبات الأرضية والغواصات. يمكن استخدام هذه الأنظمة للاستطلاع والمراقبة والعمليات القتالية، ومن المرجح أن تلعب دورًا متزايدًا في الحروب في المستقبل.

لا تزال أنظمة الأسلحة والمركبات ذاتية القيادة في مراحلها الأولى من التطوير، ولكن لديها القدرة على إحداث ثورة في الطريقة التي تُخاض بها الحروب. على سبيل المثال، يمكن استخدام المركبات الجوية بدون طيار التي تعمل بالذكاء الاصطناعي للقيام بمهام خطيرة دون المخاطرة بأرواح الطيارين. كما يمكن استخدامها لجمع المعلومات الاستخباراتية عن قوات العدو وتنفيذ ضربات دقيقة.

يمكن استخدام المركبات الأرضية ذاتية القيادة في مراقبة الحدود ونقل الإمدادات وحتى المشاركة في القتال. كما يُمكن استخدام الغواصات ذاتية القيادة في مراقبة الحدود البحرية وجمع المعلومات الاستخباراتية عن سفن العدو وحتى الهجوم على السفن الحربية.

يثير تطوير أنظمة الأسلحة والمركبات ذاتية القيادة عددًا من المخاوف الأخلاقية. أحدها هو أن هذه الأنظمة يمكن استخدامها للقتل دون تدخل بشري. أما مصدر القلق الآخر فهو أن هذه الأنظمة يمكن اختراقها أو حدوث خلل فيها، مما يؤدي إلى عواقب غير مقصودة حتى من الطرف الأكثر شرًا.

ولكن; وعلى الرغم من كُلِ تلك المخاوف، تستثمر الجيوش في جميع أنحاء العالم بكثافة في تطوير أنظمة الأسلحة والمركبات ذاتية القيادة، حيث يعتقدون أن هذه الأنظمة ستمنحهم ميزة كبيرة في النزاعات المستقبلية.

من بين هذه الاستثمارات ما تقوم به الولايات المُتحدة من تطويرٍ في الأسلحة والأنظمة الآلية، والتي من بينها المركبة الجوية القتالية -بدون طيار- X-47B، والمركبة الأرضية المُدرعة M-100، بالإضافة إلى Sea Hunter، السفينة دون قُبطان.

في الجانب الآخر، تقوم روسيا بتطوير عدد من الأسلحة وأنظمة المركبات الاستقلالية (Autonmous)، بما في ذلك الروبوت المُقاتل Uran-9 والغواصة Poseidlon التي تعمل بالطاقة النووية ودون قائد، وهي عبارة عن طوربيد قيل أنه قادر على هلاك بريطانيا بأكملها.

أما في أقصى شرق الكُرة الارضية، فهُناك الصين، ونجد هُنا طائرات Wing Loong II بدون طيار وغواصة أُخرى بدون قائد وتعمل أيضًا بالطاقة النووية تحمل اسم Type-093B.

تعد الطائرات والسفن والغواصات المستقلة التي تعمل بالذكاء الاصطناعي تقنيات جديدة ومثيرة للقلق في مجال الحرب. من المهم أن نكون على دراية بالآثار المحتملة لهذه الأسلحة، وأن نأخذ خطوات لضمان استخدامها بطريقة مسؤولة.

من يصبح الرائد في هذا المجال سيصبح حاكم العالم. – فلاديمير بوتين – سبتمبر 2017

التنبؤات المُستقبلية

يعتمد النجاح العسكري إلى حد كبير على الإدارة والتخطيط وراء الخطوط الأمامية، بما في ذلك صيانة المعدات العسكرية. يمكن لخوارزميات الصيانة التنبؤية استخدام البيانات من مستشعرات ساحة المعركة وغيرها من المصادر للتنبؤ بفشل المعدات قبل حدوثها.

على سبيل المثال، يمكن استخدام الذكاء الاصطناعي للتنبؤ بموعد فشل محرك مركبة ما، بناءً على عوامل مثل عمر المركبة وعدد الكيلومترات المقطعة وسجل الصيانة. يمكن بعد ذلك استخدام هذه المعلومات لجدولة الصيانة قبل فشل المحرك، مما يمنع التوقف غير المكلف ويضمن توفر المركبة عند الحاجة.

كذلك يستطيع الذكاء الاصطناعي تحليل البيانات من مستشعرات الطيران لتحديد الأنماط التي تشير إلى وجود أعطال محتملة. يمكن بعد ذلك استخدام هذه المعلومات لجدولة الصيانة أو استبدال المكونات قبل تعطُّلِها، مما يرفع من مستويات الأمان.

من خلال استخدام الذكاء الاصطناعي للتنبؤ بفشل المعدات، يمكن لقطاع الدفاع ضمان أن المعدات العسكرية دائمًا في حالة الذروة، مما يزيد من الجاهزية التشغيلية والميزة الاستراتيجية.

على سبيل المثال، في عام 2019، أطلقت العلامة التُجارية العملاقة في عالم السيارات Rolls-Royce برنامج IntelligentEngine الخاص بها، والذي يستخدم الذكاء الاصطناعي لمراقبة أداء المحرك والتنبؤ باحتياجات الصيانة. تم استخدام البرنامج للكشف عن الأعطال في المحركات ومنعها على مجموعة متنوعة من الطائرات، بما في ذلك Boeing 787 و Airbus A350.

في الناحية الأُخرى، يوجد نوع آخر من التنبؤات المُستقبلية.

رصد التهديدات والوعي بالوضع هما أمران ضروريان للعمليات العسكرية. يتضمنان جمع المعلومات وتحليلها لفهم الوضع الحالي وتحديد التهديدات المحتملة. يتم استخدام الذكاء الاصطناعي لتطوير أنظمة جديدة ومحسنة لرصد التهديدات والوعي بالوضع.

يمكن استخدام الذكاء الاصطناعي لتحسين رصد التهديدات والوعي بالوضع بعدد من الطرق. على سبيل المثال، يمكن استخدام أجهزة الاستشعار التي تعمل بالذكاء الاصطناعي لاكتشاف وتتبع التهديدات في الوقت الفعلي. كما يمكن استخدام الذكاء الاصطناعي لتحليل كميات كبيرة من البيانات من مجموعة متنوعة من المصادر، مثل صور الأقمار الصناعية وبيانات الرادار ومشاركات وسائل التواصل الاجتماعي، لتحديد الأنماط والاتجاهات التي قد تشير إلى هجوم محتمل.

تستخدم القوات العسكرية الأمريكية طائرة الاستطلاع RQ-4 Global Hawk لمراقبة الحدود بينها وبين المكسيك. حيث يمكن للطائرة Global Hawk الطيران على ارتفاعات عالية لفترات طويلة من الزمن، مما يجعلها مثالية لمهام المراقبة. وهي مجهزة بمجموعة متنوعة من المستشعرات، بما في ذلك الرادار والكاميرات الكهروضوئية والكاميرات بالأشعة تحت الحمراء. يسمح هذا لها بجمع معلومات مفصلة عن قوات العدو وتحركاتها.

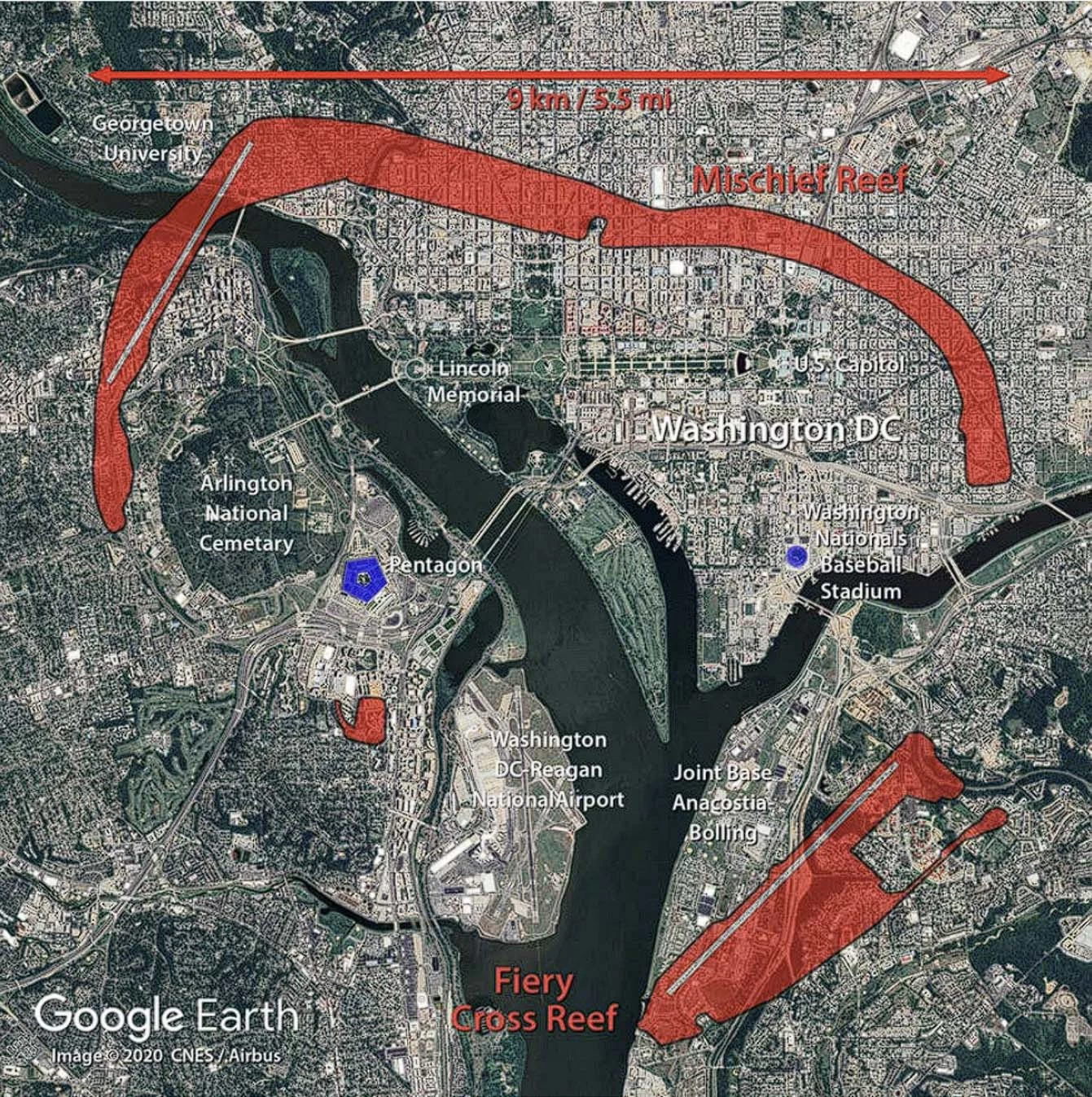

يستخدم الجيش الصيني هو الآخر أجهزة استشعار تعمل بالذكاء الاصطناعي لمراقبة بحر الصين الجنوبي. تتضمن خطة المراقبة عددًا غير محدد من أجهزة الاستشعار على قاع المحيط، متصلة عبر كابلات بصرية بمركز للمعالجة والرصد في شانغهاى، وقد أظهرت صور الأقمار الصناعية من عام 2018 موقعًا جديدًا للكشف على التوجه عالي التردد (HF/DF) على شعاب Mischief المحتلة من قبل الصين في أرخبيل Spratly.

وفي الناحية الأُخرى تمامًا، نجد إيلون ماسك في مُعضلة سُميت بـ Elon Musk’s Ukraine Dilema، عندما صدر تقرير من الـ CNN يُفيد بأن إيلون ماسك قد طلب من مُهندسيه إيقاف عمل أقمار Starlink الصناعية بالقرب من ساحل كريميان بأوكرانيا، وقد علّق على هذا في وقتٍ لاحق إيلون ماسك، مُؤكدًا أنه لم يكن قد تم إطلاق أقمار صناعية بالقرب من ساحل كريميان من الأساس، وبالتالي فإن أخبار إيقاف عملها هي أخبار لا تمت للصحة بصلة، مُشيرًا إلى أنه إذا كان قد وافق على طلب الحكومة الأوكرانية، كان سيزُج بستارلينك مُباشرةً في الحرب القائمة بين روسيا وأوكرانيا، وهو ما لم يكن يُريده.

جيش الاحتلال والذكاء الاصطناعي

يستخدم جيش الاحتلال كاميرات تعمل بالذكاء الاصطناعي لمراقبة الحدود بين الدولة المُحتلة وقطاع غزة، وقد صدر تقريرٌ في يوليو من العام الماضي يُفيد تعاقد الحكومة المُحتلة مع شركتي آمازون وجوجل لتطوير نظام سحابي يُدعى (Project Nimbus)، وهو مشروع أعلنت عنه وزارة المالية في الدولة المُحتلة في أبريل من عام 2021، قُدِّرت قيمته بمليار ومائتي مليون دولار، وذلك بهدف إمداد جيش الاحتلال بتقنيات التعرُّف على الأوجه وتمييز الصور وتتبع الأشياء وغيرها من التقنيات التي تضمنها هذا المشروع.

واجهت كِلتا الشركتين عدد هائل من الاحتجاجات على هذه الخُطوة من قِبل الموظفين، إلا أن كُلً منهما قد مضى قِدمًا في إبرام التعاقد، ولم يكن من جوجل سوى أن أخرجت المُتحدث باسم Google Cloud، المدعو Atle Erlingsson ليقول أن هذا العمل ليس حساسًا بشكلٍ مُباشر ولا يُصنف كعمل عسكري.

مُجرد هُراء بِكُلِ تأكيد، حتى أن صحيفة France24 قد وضعت الشركتين في وضعٍ حرِج عندما نشرت تقريرًا يتحدث عن كيفية استخدام الدولة المُحتلة تقنيات التعرُّف على الأوجه لمُراقبة فلسطينيي الضفة الغربية.

الانسان مُحركًا لكُل شيء

بوصولك إلى هذه النقطة، أرى أنك تتفق معي فيما قُلته بخصوص تغيير الذكاء الاصطناعي للحروب وأن العالم لن ولم يعد كما كان قبل ابتكاره، ولكن..

ما حدث خلال الأيام الماضية قد أثبت بما لا يدع مجالًا للشك أن العقل البشري مازال قادرًا على التفوق على كافة أنظمة الذكاء الاصطناعي.

في السابع من أكتوبر الجاري، شنّت حركة حماس هجومًا على الأراضي الإسرائيلية، باستخدام مظليين للمرة الأولى في تاريخها. وقد تمكنت قوات حماس من التسلل إلى الأراضي الإسرائيلية عبر البحر والبر، ونجحت في التفوق على كل المعدات وتقنيات الذكاء الاصطناعي التي يستخدمها الجيش الإسرائيلي في اكتشاف التهديدات.

وبحسب ما أعلنته حركة حماس، فقد استخدمت مظلات صغيرة مصنوعة من مواد محلية يمكنها حمل مقاتل واحد فقط. كانت هذه المظلات صغيرة بما يكفي للهروب من أنظمة الدفاع الإسرائيلية المصممة لتتبع الأجسام الكبيرة، مزودة بمحركات طاقة، وإمكانية تحكم، تجعلها قابلة للانطلاق من الأرض، دون الحاجة لتنفيذ إنزال جوي من السماء بواسطة طائرة.

ساعد هذا الأمر في التغلب على القبة الحديدية التي تعتمد على الرادارات والكاميرات لاكتشاف التهديدات الجوية وهي أحد أكثر الأنظمة الدفاعية دقة وتطورًا في العالم.

كما استخدمت حماس أجهزة لاسلكية صغيرة لتوجيه المظلات بشكل آمن إلى أهدافها. سمحت هذه الأجهزة للمظليين بتحديد أهدافهم بدقة وتجنّب دفاعات الاحتلال.

ولقد أظهرت هذه العملية مدى قدرة العقول البشرية على التفوق على التكنولوجيا المتقدمة. فقد تمكن مقاتلو حماس، باستخدام أكثر المعدات بدائية والتخطيط المُسبق واستغلال عنصر المُفاجأة، من تنفيذ هجوم مفاجئ وفعال، ألحق خسائر كبيرة بجيش الاحتلال.

كما أظهر هذا الهجوم أن جيش الدولة المُحتلة لا يزال لديه نقاط ضعف يمكن استغلالها من قبل أعدائه.

الخُلاصة

أصبح من الواضح أن الذكاء الاصطناعي قد أرست أقدامه بثبات في ميدان الحروب والعمليات العسكرية. تقدم التكنولوجيا والاستفادة الفعالة من إمكانات الذكاء الاصطناعي أحدثا تحولات جوهرية في استراتيجيات وتنفيذ العمليات العسكرية. تعتبر هذه التقنيات فرصًا مذهلة لتعزيز الأمان الوطني ورفع كفاءة القوات المسلحة في الدولِ كافة.

ومع ذلك، يجب علينا عدم تجاهل حقيقة أن القوة الكبيرة تحمل مسؤوليات كبيرة. يجب أن يكون الاستخدام الأخلاقي والمسؤول للذكاء الاصطناعي هو الأساس الذي نبني عليه، موجهًا تلك التقنيات نحو تعزيز السلام والأمان العالميين. في هذا السياق، يتوجب على المجتمع الدولي والقوى العسكرية توجيه جهودهم نحو مستقبل يجمع بين القوة التكنولوجية والأخلاقية لضمان عالم أكثر أمانًا وهو ما نتمناه جميعًا -مع بعض المُبالغة.

مرةٌ أُخرى، رحم الله كُل من مات دفاعًا عن الوطن.

?xml>

Source link